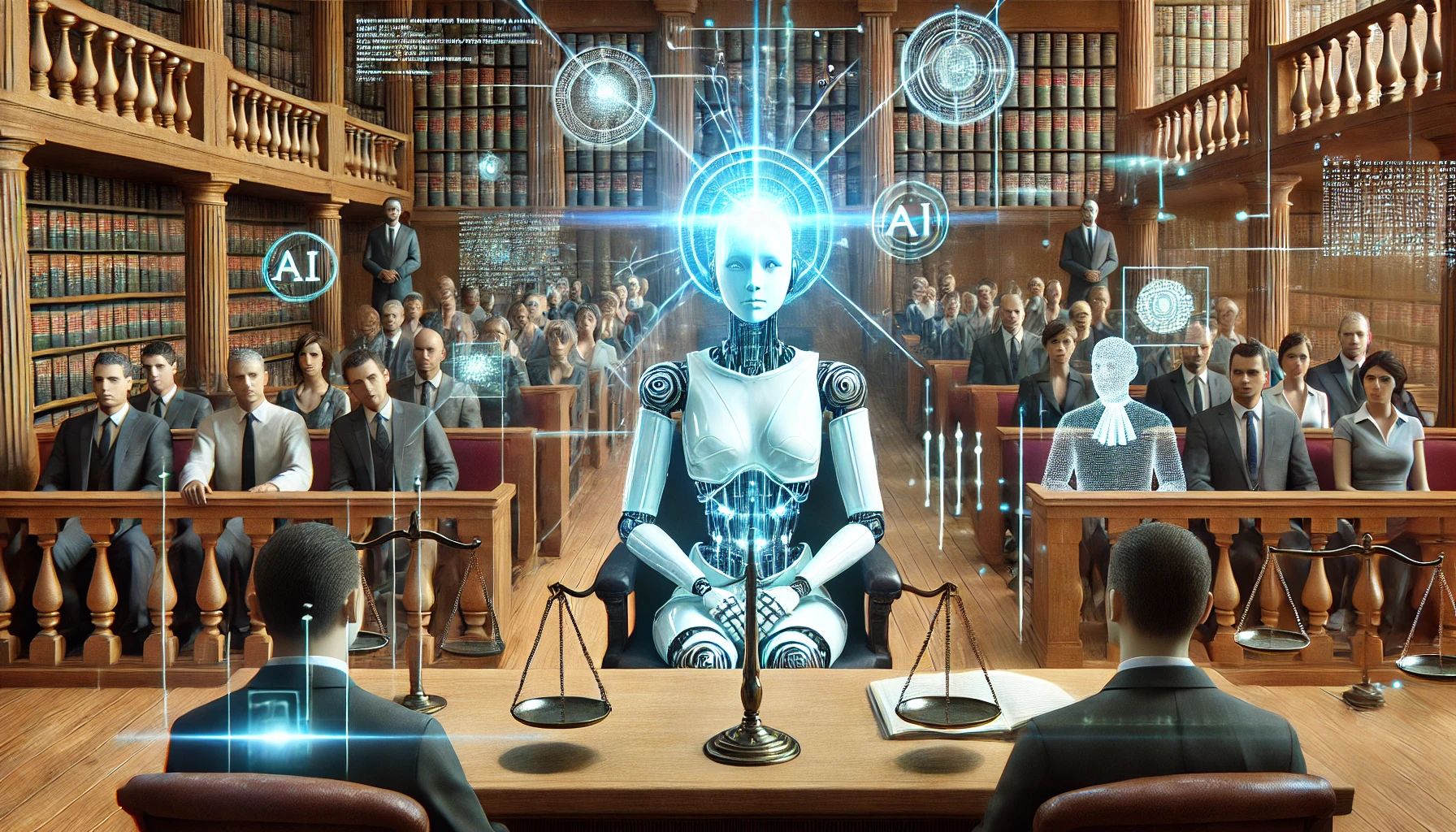

Desde la predicción de sentencias hasta la identificación de patrones en grandes cantidades de datos judiciales, la IA está siendo adoptada para hacer que los sistemas legales sean más eficientes y accesibles. Sin embargo, este cambio también plantea preocupaciones éticas, legales y técnicas. En este artículo, exploramos los pros y contras del uso de IA en la justicia, basándonos en estudios recientes y casos reales.

Pros del Uso de la IA en la Justicia

1. Eficiencia en Procesos Judiciales

Una de las mayores ventajas de la IA es su capacidad para procesar enormes volúmenes de datos en poco tiempo. Según un estudio publicado en Harvard Law Review, herramientas de IA como ROSS Intelligence pueden analizar miles de documentos legales y precedentes en cuestión de segundos, ahorrando tiempo a abogados y jueces.

- Caso real: En Estonia, se han implementado jueces-robots para resolver disputas menores, reduciendo significativamente el tiempo de resolución de casos simples.

2. Acceso a la Justicia para Todos

La IA puede ayudar a democratizar el acceso a la justicia al ofrecer servicios legales a bajo costo o incluso gratuitos. Herramientas como DoNotPay, un chatbot de IA, han ayudado a miles de personas a disputar multas de estacionamiento o solicitar reembolsos, proporcionando asesoramiento legal básico sin necesidad de un abogado.

3. Reducción de Sesgos Humanos

A diferencia de los humanos, la IA puede ser programada para tomar decisiones basadas únicamente en datos objetivos, lo que podría reducir los prejuicios conscientes o inconscientes que afectan las decisiones judiciales. Esto es especialmente relevante en casos de discriminación racial o de género.

4. Predicción de Resultados Legales

La IA puede analizar patrones en decisiones judiciales previas para predecir resultados en casos similares. Esto no solo ayuda a los abogados a preparar estrategias, sino que también proporciona a los clientes una visión más clara de sus posibilidades.

- Estudio destacado: Un informe de la Universidad de Stanford mostró que los algoritmos de IA alcanzaron un 79% de precisión en la predicción de sentencias en casos de apelación en Estados Unidos.

Contras del Uso de la IA en la Justicia

1. Sesgos Algorítmicos

Aunque la IA puede reducir sesgos humanos, no está exenta de sus propios sesgos. Los algoritmos dependen de los datos con los que son entrenados, y si esos datos están sesgados, la IA reproducirá esos prejuicios.

- Caso controvertido: En 2016, el software COMPAS, utilizado en EE. UU. para evaluar riesgos de reincidencia, fue criticado por ser racialmente sesgado, clasificando de manera desproporcionada a los acusados afroamericanos como de alto riesgo.

2. Falta de Transparencia

Los algoritmos de IA son a menudo cajas negras: sus procesos internos no son comprensibles para la mayoría de los usuarios, incluidos jueces y abogados. Esto plantea dudas sobre cómo se toman las decisiones y dificulta la rendición de cuentas.

3. Pérdida de Humanidad en el Proceso Judicial

La justicia no solo trata de aplicar reglas, sino también de considerar el contexto humano. La empatía, la moral y la experiencia son aspectos esenciales en las decisiones judiciales, y la IA no puede replicar estos atributos.

4. Dependencia Tecnológica

El uso excesivo de IA podría llevar a una dependencia tecnológica que deje a los sistemas judiciales vulnerables a errores técnicos, ciberataques o fallos de programación.

- Riesgo destacado: Un informe de Amnistía Internacional advierte que la falta de regulación y supervisión podría convertir a la IA en una herramienta para perpetuar desigualdades, en lugar de eliminarlas.

Implicaciones Éticas y Legales

El uso de la IA en la justicia plantea preguntas éticas fundamentales, como quién debe ser responsable de las decisiones tomadas por algoritmos y cómo garantizar la equidad en su aplicación. Además, se necesitan marcos legales claros para regular su uso y evitar abusos.

1. Regulación Internacional Organismos como la Unión Europea han propuesto leyes para garantizar que la IA en la justicia sea transparente, imparcial y segura. La Ley de Inteligencia Artificial de la UE clasifica los sistemas judiciales como de alto riesgo y establece requisitos estrictos para su implementación.

2. Educación y Capacitación Para integrar la IA de manera efectiva, jueces, abogados y otros actores del sistema judicial deben estar capacitados en su uso y limitaciones. Esto garantizará que la IA sea utilizada como una herramienta complementaria, no como un reemplazo total.

Conclusión

El uso de la IA en la justicia tiene el potencial de transformar los sistemas legales, haciendo que sean más eficientes y accesibles. Sin embargo, también plantea riesgos significativos que deben abordarse mediante regulación, supervisión y educación. La clave estará en encontrar un equilibrio entre aprovechar los beneficios tecnológicos y garantizar que los principios de justicia, equidad y humanidad no se vean comprometidos.

¿Estamos preparados para confiar en máquinas para administrar justicia, o debemos priorizar siempre el juicio humano como garantía de equidad? El debate está abierto y será crucial en los próximos años.

Fuentes:

- Harvard Law Review, «AI in Law: Opportunities and Challenges» (2022).

- Stanford University Report, «Predictive Analytics in Judicial Systems» (2021).

- Amnistía Internacional, «AI and Human Rights» (2023).

- Unión Europea, «AI Act Proposal» (2023).